这不仅仅是一个技术术语,它代表了人工智能领域在过去十年里最重要的一次革命,深刻地改变了我们与计算机交互、获取信息乃至创造内容的方式。

我会从以下几个方面为您详细解读:

- 它是什么? (定义与核心思想)

- 它如何工作? (核心技术与架构)

- 它经历了怎样的演变? (从RNN到Transformer的里程碑)

- 它有什么能力与局限? (优点与挑战)

- 它有哪些典型应用? (现实世界的例子)

- 未来展望

它是什么?(定义与核心思想)

人工智能语言神经网络,通常我们直接称之为大型语言模型,是人工智能的一个分支,它专门研究和处理人类语言。

核心思想: 它的核心思想是“语言建模”,就是通过学习海量的文本数据(比如整个互联网的书籍、文章、网页等),让计算机模型掌握语言的规律,包括语法、语义、上下文关系、知识事实,甚至是推理和创造能力。

这个模型不是基于人类编写的规则(主语+谓语+宾语”),而是通过数学和统计方法,从数据中自动学习这些规则,它本质上是一个极其复杂的数学函数,能够根据你输入的文本(提示词),预测出最有可能的、最合理的下一个词,然后不断地重复这个过程,生成一段连贯、有意义的文本。

它如何工作?(核心技术与架构)

语言神经网络的工作原理可以分解为几个关键部分:

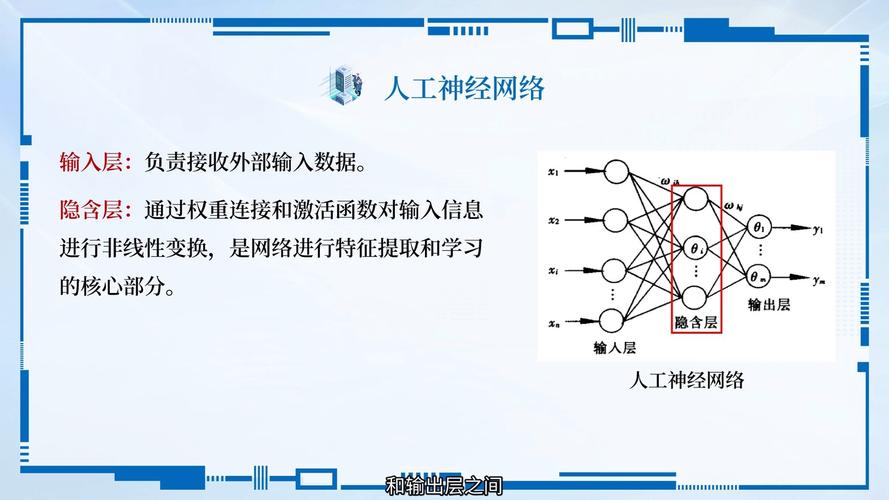

a. 基本单元:神经网络

- 神经元:模型的基本计算单元,接收输入,进行加权求和,然后通过一个激活函数处理,产生输出。

- 层:大量的神经元组织成层,通常包括输入层、隐藏层和输出层,信息从输入层流向输出层,在隐藏层中被不断加工和提炼。

b. 关键技术:词嵌入

计算机不理解文字“猫”本身,它只懂数字。词嵌入就是解决这个问题的技术,它将每个词语、甚至每个字符,映射成一个高维度的向量(一串数字)。

- 神奇之处在于:语义上相近的词,它们的向量在空间中的距离也相近。“国王”和“女王”的向量距离,会比“国王”和“香蕉”的向量距离近得多,这让模型能够“理解”词语之间的关系。

c. 核心机制:注意力机制

这是现代语言模型(尤其是Transformer架构)的灵魂,在处理长句子时,传统的模型很难记住前面的信息,注意力机制允许模型在处理当前词语时,能够“关注”到输入文本中所有其他词语的重要性,并给予不同的权重。

- 比喻:当你翻译一句话时,你可能会先看完整句,然后在翻译某个词时,回头去参考句子的主语或关键词,注意力机制就是让模型拥有这种“回头参考”的能力,极大地提升了处理长距离依赖关系的能力。

d. 核心架构:Transformer

这是当前所有主流大语言模型(如GPT系列、LLaMA、PaLM等)的基石,它完全基于注意力机制,摒弃了早期的循环神经网络结构。

- 自注意力:Transformer的核心是自注意力层,它能让句子中的每个词都直接与其他所有词进行交互,从而高效地捕捉整个句子的结构和语义。

- 编码器-解码器:最初的Transformer包含编码器和解码器两部分,编码器负责理解输入文本,解码器负责生成输出文本,后来的模型(如GPT)简化为只有解码器,专注于文本生成任务。

它经历了怎样的演变?(从RNN到Transformer的里程碑)

语言神经网络的发展史就是一部不断突破技术瓶颈的历史:

-

早期:循环神经网络

- 特点:能够处理序列数据,像人一样“记忆”前面的信息,但它一次只能处理一个词,存在长距离依赖问题(记不住太长的上下文),且训练难以并行化,效率低。

-

突破:长短期记忆网络 / 门控循环单元

- 特点:是RNN的改进版,通过“门”机制(输入门、遗忘门、输出门)来控制信息的流动,解决了部分长距离依赖问题,但根本瓶颈依然存在。

-

革命:Transformer架构 (2025年)

- 诞生:由Google在论文《Attention Is All You Need》中提出。

- 意义:完全抛弃了循环结构,仅使用注意力机制,这使得模型可以并行处理所有词语,极大地提高了训练速度和效率,并且能更好地捕捉长距离依赖关系,这是现代大语言模型的基石。

-

爆发:GPT系列 (Generative Pre-trained Transformer)

- GPT-1/2:展示了“预训练+微调”范式的强大,先用海量数据预训练一个通用模型,再针对特定任务(如问答、进行微调。

- GPT-3 (2025):模型参数量达到1750亿,展现了惊人的“涌现能力”(Emergent Abilities),即模型规模大到一定程度,突然获得了小模型没有的能力,如少样本学习、上下文学习等,你只需要给它几个例子,它就能学会新任务。

- ChatGPT (GPT-3.5/4):通过人类反馈强化学习技术,让模型更“乐于助人”、更“安全”、更“符合人类价值观”,从而成为一个优秀的对话伙伴。

它有什么能力与局限?(优点与挑战)

能力 (Strengths)

- 强大的文本生成能力:写文章、写代码、写诗、写剧本,流畅自然。

- 卓越的理解能力:理解复杂指令、进行阅读理解、情感分析。

- 多模态交互:最新的模型(如GPT-4V)可以理解图片、音频,实现图文对话。

- 知识问答:像一个“行走的百科全书”,能回答各种事实性问题。

- 逻辑推理:在数学、逻辑谜题上表现出色。

局限与挑战 (Limitations & Challenges)

- “一本正经地胡说八道” (Hallucination):模型会编造事实、引用不存在的文献,因为它本质上是“预测最可能的词”,而不是在“检索事实”。

- 知识截止:模型的知识受限于其训练数据的时间点,无法知道之后发生的事件。

- 偏见与歧视:训练数据中包含人类社会存在的偏见(如性别、种族偏见),模型会学习并放大这些偏见。

- 缺乏真正的理解与意识:它没有主观体验、情感和自我意识,它的“智能”是一种复杂的模式匹配和概率计算,而非人类式的认知。

- “黑箱”问题:我们很难解释模型为什么会给出某个特定的答案,其决策过程不透明。

- 巨大的资源消耗:训练和运行这些模型需要海量的计算资源和能源。

它有哪些典型应用?(现实世界的例子)

- 智能对话系统:ChatGPT、Google Bard、Claude等聊天机器人。

- 代码生成与辅助:GitHub Copilot,帮助程序员自动编写代码、调试和解释代码。

- 内容创作:营销文案、新闻稿、小说、剧本的初稿撰写。

- 搜索引擎:New Bing、Google的SGE(Search Generative Experience),用生成式摘要直接回答用户问题。

- 教育与培训:个性化辅导、语言学习伙伴、生成练习题。

- 专业领域应用:法律文件分析、医疗报告辅助生成、金融数据分析。

- 创意设计:生成图片描述、提供创意灵感。

未来展望

语言神经网络的发展仍在高速进行中,未来可能的方向包括:

- 多模态融合:文本、图像、音频、视频、3D模型等多种信息的无缝理解和生成。

- 模型小型化与高效化:在保持能力的同时,降低对计算资源的需求,使其能在手机、汽车等端侧设备上运行。

- 更强的推理与规划能力:从简单的语言生成,走向解决复杂的多步推理任务和规划任务。

- AI智能体:模型不再只是被动回答问题,而是能主动理解目标、制定计划、使用工具(如调用API、上网搜索)来完成复杂任务。

- 可解释性与安全性:努力打开“黑箱”,让AI的行为更可控、更安全、更符合伦理。

人工智能语言神经网络是一场由数据、算法和算力共同驱动的技术革命,它通过在海量文本中学习语言的内在规律,赋予了机器前所未有的理解和生成人类语言的能力,它既是强大的生产力工具,也带来了关于伦理、安全和社会影响的深刻挑战,理解它,就是理解我们这个时代最激动人心的技术变革之一。

标签: AI语言神经网络理解人类语言的原理 AI如何通过神经网络解析人类语言 神经网络模型下AI语言理解机制