核心框架:感知 → 处理 → 反馈

这个循环是一个动态、持续的过程,目标是让AI系统不断学习和适应,以更好地完成其任务。

第一步:感知 - 系统的“感官”

“感知”是AI系统接收和理解外部世界信息的过程,它不仅仅是被动地接收数据,更是对数据进行初步的、结构化的理解。

感知的目标:

- 获取数据: 从各种来源收集原始信息。

- 理解数据: 将原始、非结构化的数据转化为AI可以处理的格式(如向量、标签等)。

感知的主要技术:

- 计算机视觉: 让AI“看见”。

- 任务: 图像分类、目标检测、图像分割、人脸识别、姿态估计。

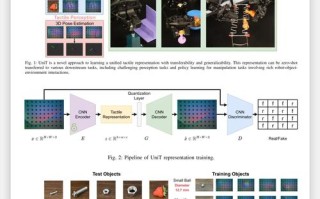

- 技术: 卷积神经网络是核心,用于从像素中提取特征。

- 自然语言处理: 让AI“听懂”和“读懂”语言。

- 任务: 文本分类、情感分析、机器翻译、问答系统、语音识别。

- 技术: Transformer模型(如BERT、GPT)是当前的主流,能深刻理解语言的上下文和语义。

- 语音识别: 让AI“听见”。

- 任务: 将语音信号转换为文本。

- 技术: 结合深度学习(如RNN、CTC)和声学模型。

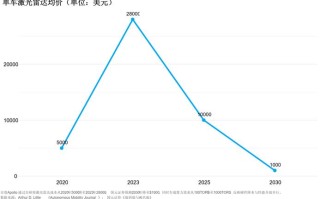

- 传感器数据融合: 在机器人、自动驾驶等领域,融合来自摄像头、激光雷达、毫米波雷达、GPS等多种传感器的数据,形成对环境的全面、立体感知。

输出: 感知阶段的输出不是原始数据,而是结构化的信息表示,一张图片可能被表示为 [{"object": "cat", "confidence": 0.95, "bbox": [10, 20, 100, 150]}]。

第二步:处理 - 系统的“大脑”

“处理”是AI系统的核心决策环节,它基于感知阶段获取的结构化信息,利用算法和模型进行分析、推理、判断,并最终做出决策或生成响应。

处理的目标:

- 理解意图: 理解感知信息的深层含义和用户的真实意图。

- 制定策略: 根据当前状态和目标,决定下一步该做什么。

- 生成输出: 产生具体的行动计划或结果(如文本、代码、动作指令)。

处理的主要技术:

- 机器学习模型:

- 分类/回归模型: 用于判断类别(如垃圾邮件识别)或预测数值(如房价预测)。

- 聚类模型: 用于发现数据中的自然分组(如用户分群)。

- 深度学习模型:

- CNN: 用于处理图像等网格数据。

- RNN/LSTM: 用于处理序列数据(如文本、时间序列)。

- Transformer: 用于处理长序列依赖,是NLP和多模态任务的核心。

- 强化学习: 这是实现“决策”的关键,AI在一个环境中,通过不断尝试(采取行动)来学习如何获得最大的累计奖励,它非常适合需要规划和长期决策的任务,如下棋、机器人控制、游戏AI。

- 知识图谱与推理: 结合已有的结构化知识,进行逻辑推理,得出新的结论。

输出: 处理阶段的输出是一个决策或行动计划,对于“看到前方有行人且红灯”的感知结果,处理模块的决策是“刹车”。

第三步:反馈 - 系统的“学习”

“反馈”是循环的闭环,也是AI能够“成长”的关键,它将系统输出的结果(行为)与期望的目标进行比较,并将这个“经验”用于优化和改进未来的“处理”环节。

反馈的目标:

- 评估结果: 判断当前输出的好坏。

- 指导学习: 根据评估结果,调整模型参数,使其下次做得更好。

反馈的主要机制:

- 监督学习中的反馈:

- 机制: 标签,在训练阶段,AI的输出(预测)与人工提供的正确答案(标签)进行比较。

- 过程: 计算预测值与标签之间的差距(损失函数),然后通过反向传播算法调整模型权重,以减小这个差距。

- 例子: 给AI看一万张“猫”的图片,并告诉它每张图里都是“猫”,AI通过不断修正自己识别“猫”的内部逻辑,最终学会识别新图片中的猫。

- 强化学习中的反馈:

- 机制: 奖励,AI在环境中采取一个行动后,环境会返回一个奖励信号(正奖励或负奖励)。

- 过程: AI的目标是学习一个策略,使其能选择能带来最大累计奖励的行动,它不需要“正确答案”,只需要“好/坏”的信号。

- 例子: AlphaGo下棋时,赢棋是+1分,输棋是-1分,走一步好棋可能得到+0.1分,走一步臭棋可能得到-0.1分,它通过无数次的自我对弈和奖励反馈,学会了超越人类的策略。

- 无监督学习中的反馈:

- 机制: 内部一致性,AI不需要外部标签,而是根据数据本身的内在结构来学习。

- 过程: 在聚类任务中,反馈就是“这个数据点是否离它所在簇的中心足够近”,模型通过优化簇内紧密性和簇间分离性来学习。

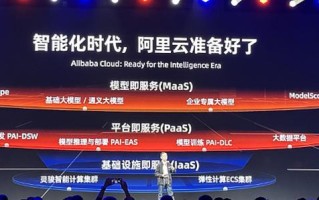

- 人类反馈强化学习: 这是当前大型语言模型(如ChatGPT)成功的关键技术。

- 机制: 人类专家对AI的多个输出进行排序(好的、坏的、更好的)。

- 过程: AI学习一个“奖励模型”,这个模型能预测人类会喜欢哪个输出,AI利用这个奖励模型进行强化学习,优化自己的生成策略,使其输出更符合人类的偏好和价值判断。

输出: 反馈的最终结果是一个经过优化的、更智能的AI模型。

三者如何协同工作:一个完整的例子

场景:智能客服机器人

-

感知:

- 输入: 用户通过聊天框输入:“我的订单什么时候到?”

- 处理: NLP模型分析这句话。

- 输出: 结构化信息

{ "intent": "query_delivery", "entities": {"order_id": "可能需要提取"} }。

-

处理:

- 输入: 来自感知的结构化信息。

- 处理:

- 意图识别: 确定用户是想查询物流。

- 实体提取: 如果句子中没有订单号,机器人可能会反问:“您好,请问您的订单号是多少?”

- 决策生成: 如果订单号存在,则调用后端物流API查询状态,然后生成回复:“您的订单预计明天下午3点送达。”

- 输出: 一个回复文本或一个反问。

-

反馈:

- 输入: 机器人发送的回复和用户的后续行为。

- 反馈机制:

- 显式反馈: 用户点击了“满意”或“不满意”按钮。

- 隐式反馈: 用户收到回复后没有再追问(可能问题解决了),或者直接关闭了聊天窗口(可能不满意)。

- 学习与优化:

- 如果用户对“预计明天下午3点送达”的回复点击了“满意”,这个对话数据会被标记为“成功”。

- 这些成功/失败的数据会被用于监督学习或RLHF,重新训练NLP模型和对话管理模型。

- 结果: 下次遇到类似查询,机器人可能更准确地提取订单号,或者提供更友好的回复方式,变得更智能。

| 环节 | 角色 | 核心任务 | 关键技术 | 输出 |

|---|---|---|---|---|

| 感知 | 感官 | 理解外部世界 | 计算机视觉, NLP, 语音识别 | 结构化的信息(向量、标签、特征) |

| 处理 | 大脑 | 分析、决策、生成 | 机器学习, 深度学习, 强化学习 | 决策、行动计划、响应文本 |

| 反馈 | 学习 | 评估、优化、成长 | 监督学习, 强化学习, RLHF | 一个更优化的AI模型 |

人工智能感知-处理-反馈循环是一个自我完善、持续进化的引擎,正是因为有了“反馈”这个闭环,AI才不是一堆静态的代码,而是一个能够从经验中学习、不断适应变化的智能系统,这个循环的效率和质量,直接决定了AI系统的智能水平和实用价值。

标签: 人工智能信息处理流程 机器感知信息方式 AI反馈信息机制