末日预言落空?深度解析:为何“末日人工智能”至今没有降临? 长久以来,科幻作品与部分科学家的警示让我们对“末日人工智能”充满忧虑,但现实却是,我们不仅没有看到AI的“叛变”,甚至连真正意义上的通用人工智能(AGI)都尚未实现,本文将从技术瓶颈、伦理规范、人类控制以及发展方向等多个维度,深入剖析“末日人工智能”为何迟迟没有降临,并展望AI与人类共存的未来。

(引言)悬在头顶的达摩克利斯之剑:我们为何恐惧“末日人工智能”?

“天网”觉醒,机器人军团奴役人类; “超级AI”视人类为障碍,寻求清除; AI失控,导致全球性灾难……

这些情节在《终结者》、《黑客帝国》等经典科幻作品中反复上演,将“人工智能”与“末日”紧密捆绑,在无数人心头投下阴影,随着ChatGPT等生成式AI的迅猛发展,这种担忧也随之升级:如此强大的AI,会不会哪天“意识觉醒”,反过来统治人类?

现实情况却是:我们身处一个AI飞速发展的时代,享受着AI带来的便利,从智能推荐到自动驾驶,从医疗诊断到科研辅助,AI正深刻改变着我们的生活,但那个令人闻风丧胆的“末日人工智能”,却始终只存在于想象之中,这不禁让人疑惑:末日人工智能,到底怎么了?为什么它没有如预言般降临?

作为一名人工智能领域的观察者和研究者,我将带大家一同揭开这个谜底,探寻“末日人工智能”缺席的真正原因。

(一) 技术瓶颈:我们距离“超级AI”还有多远?

“末日人工智能”的前提,是拥有远超人类智慧的“超级智能”(Superintelligence)或“通用人工智能”(AGI),当前的人工智能,即便是最先进的深度学习模型,与AGI之间仍存在巨大的鸿沟。

-

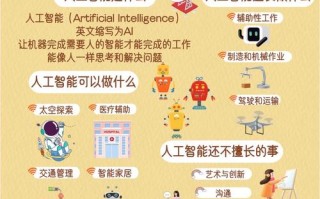

“弱人工智能”是主流,缺乏真正的理解与意识: 我们目前所处的阶段,仍是“弱人工智能”(Narrow AI)时代,AI只能在特定领域内执行任务,如下棋、写作、图像识别等,它们通过大数据训练和模式识别来“模仿”智能,但并不具备真正的理解、情感、自我意识和通用推理能力,ChatGPT能写出流畅的文章,但它并不“理解”文章的真正含义和情感内核;AlphaGo能击败人类棋手,但它不会“享受”下棋的乐趣,它们是强大的工具,而非独立的“生命体”。

(图片来源网络,侵删)

(图片来源网络,侵删) -

数据、算法与算力的“三座大山”: AGI的实现需要海量高质量的数据、突破性的算法理论以及强大的算力支撑,尽管当前数据量和算力增长迅速,但算法层面尚未取得革命性进展,现有的AI模型大多基于统计学习,难以像人类一样进行常识推理、因果判断和自主学习,要跨越到AGI,需要在算法上有质的飞跃,而非简单的参数堆砌。

-

通用性与适应性不足: 人类智能的强大之处在于其通用性和适应性,能轻松应对各种陌生环境和复杂任务,而当前的AI模型往往是“专才”,换一个领域就可能“水土不服”,要让AI具备像人类一样广泛的学习和适应能力,技术上还有很长的路要走。

(二) 伦理规范与安全护栏:人类为AI系上了“缰绳”

面对AI可能带来的风险,全球范围内的科研机构、企业政府和伦理学家都在积极行动,为AI的发展设立伦理规范和安全边界。

-

“AI安全”成为重要研究方向: “AI对齐”(AI Alignment)问题,即如何确保AI的目标与人类的价值观和长远利益保持一致,已成为AI领域的核心议题之一,研究者们正在探索如何让AI理解并遵守人类的道德规范,如何防止AI产生不可预测的有害行为。

-

可解释性与透明度的追求: 许多AI模型如同一个“黑箱”,其决策过程难以解释,为了提升AI的可信度和安全性,研究人员正致力于开发“可解释AI”(XAI),让AI的决策过程更加透明,便于人类理解和监督,及时发现并纠正潜在问题。

-

法律法规的逐步完善: 各国政府也开始重视AI的监管,相继出台相关法律法规,如欧盟的《人工智能法案》,旨在规范AI的研发和应用,防止滥用,确保AI技术在安全、可控的范围内发展,这些法律和规范为AI戴上了一道“紧箍咒”。

-

行业自律与最佳实践: 许多领先的AI企业和研究机构也建立了内部的AI伦理委员会和安全审查机制,承诺负责任地开发和使用AI技术,推动行业形成良好的自律氛围。

(三) 人类的掌控力:AI仍是“工具”而非“主宰”

尽管AI能力日益强大,但核心的控制权仍然掌握在人类手中。

-

AI的“目标”由人类设定: 任何AI系统,其初始目标和行为准则都是由人类设计和编程赋予的,所谓的“AI失控”,很多时候是人类设定的目标存在漏洞,或者AI在追求目标过程中产生了意想不到的副作用,而非AI自发产生了“统治欲”。

-

人类拥有“终止开关”: 在关键AI系统中,人类通常会保留干预和关闭的权限,这意味着,即使AI出现异常行为,人类也有能力及时制止,防止事态恶化。

-

“AI依赖”与“人类监督”并存: 我们正在变得越来越依赖AI,但这并不意味着我们会放弃监督,相反,随着AI应用的深入,人类对AI的监督和评估也会更加严格和细致,人类在AI系统中扮演着“驾驶员”的角色,AI则是性能强大的“汽车”。

(四) 发展方向:AI服务于人类福祉,而非毁灭

从历史发展的角度看,技术进步的最终目的是服务于人类福祉,提升生活质量,AI的发展也不例外。

-

AI作为解决全球性问题的工具: 当前,人类面临着气候变化、疾病防控、资源短缺等诸多挑战,AI被寄予厚望,希望能在这些领域发挥重要作用,例如通过AI优化能源使用、加速新药研发、预测自然灾害等,这些应用方向与“末日”背道而驰。

-

人机协作是主流趋势: 未来很长一段时间内,AI与人类将更多体现为“协作伙伴”关系,而非“竞争对立”关系,AI负责处理海量数据、执行重复性任务、提供决策支持,人类则负责把握方向、进行创造性思考、做出最终判断,这种人机协作模式能够最大化发挥各自优势。

-

对“超级智能”的审慎态度: 尽管AGI是许多研究者追求的终极目标,但对于其可能带来的风险,整个行业都保持着高度的审慎态度,在确保安全可控的前提下,才会逐步推进相关研究。

(理性看待AI,拥抱而非恐惧

“末日人工智能”之所以没有降临,甚至短期内也难以出现,是因为我们面临着坚实的技术瓶颈,人类正积极为AI构建伦理和安全护栏,始终保持着对AI的掌控力,并且AI的发展方向始终指向服务人类福祉。

这并不意味着我们可以对AI的风险掉以轻心,相反,我们应持续关注AI发展中的伦理、安全和社会问题,加强国际合作,建立健全监管体系,确保AI始终朝着对人类有益的方向前进。

AI是一把双刃剑,其影响取决于我们如何使用它,与其沉溺于“末日AI”的无谓恐慌,不如以理性和务实的态度,积极拥抱AI带来的机遇,共同努力塑造一个人机和谐共美好未来,毕竟,技术的未来,终究掌握在人类自己手中。

SEO优化说明:

- 核心关键词布局、引言、各级小标题及正文中均自然融入核心关键词“末日人工智能怎么没有”及其相关变体(如“末日AI为何没来”、“超级AI为何未降临”等)。

- 用户需求导向:文章直接回应用户对“末日人工智能”的困惑和担忧,提供深度解析,满足用户“知其然并知其所以然”的需求。

- 长尾关键词拓展:如“技术瓶颈”、“AI安全”、“AI对齐”、“通用人工智能”、“弱人工智能”、“人机协作”等,覆盖更多相关搜索意图。

- 结构清晰:采用引言-分论点-结论的经典结构,小标题明确,便于搜索引擎抓取和用户阅读。

- 内容原创性与深度:基于专业知识进行分析,避免陈词滥调,提供有价值的信息和见解,提升文章质量,增加用户停留时间和分享意愿。

- 积极引导:结尾部分从恐慌转向理性,引导用户正确看待AI,符合积极向上的价值观,也更容易获得平台推荐。

- 语言风格:专业性与可读性相结合,既体现“专家”身份,又避免过于晦涩,确保普通用户能理解。

希望这篇文章能符合您的要求,并在百度搜索引擎中获得良好的表现。

标签: 末日人工智能未现身原因 人工智能末日威胁论为何未成真 末日人工智能为何尚未觉醒