这是一个非常深刻且重要的问题,强人工智能是否会实现”,目前没有确定的答案,但我们可以从不同角度探讨其可能性、挑战以及时间表。

主流观点认为,实现强人工智能在理论上是可能的,但在实践上面临着巨大的、甚至是难以逾越的挑战。 它究竟会不会实现,以及何时实现,取决于我们能否克服这些挑战。

下面我将从几个方面详细阐述:

为什么人们认为强人工智能可以实现?(乐观派)

支持者认为,强人工智能的实现是必然的,主要基于以下几点理由:

-

物理主义的信念:他们认为,人类意识和智能是宇宙中一种物理现象,由我们大脑中亿亿亿个神经元通过复杂的电化学活动产生,既然这种智能可以在“湿件”(wetware,即生物大脑)中自然演化出来,那么理论上,只要我们能够用合适的硬件(硅基芯片或其他)和软件算法来模拟这个过程,智能也完全可以被“制造”出来,这本质上是一个工程问题,而非物理定律的限制。

(图片来源网络,侵删)

(图片来源网络,侵删) -

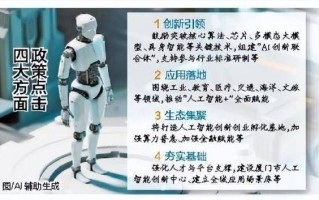

计算能力的指数级增长:摩尔定律虽然放缓,但计算能力仍在以惊人的速度提升,更强大的GPU、TPU以及未来的量子计算,为我们模拟复杂系统提供了前所未有的算力基础,我们的大脑处理信息的速度有限,而计算机可以远超这个速度。

-

算法的不断突破:从专家系统到深度学习,再到现在的生成式AI(如GPT-4),AI的能力边界在不断被拓宽,每一次技术突破都让我们离通用智能更近一步,当前的AI已经展现出初步的推理、规划和创造能力,尽管还很初级,但发展趋势是明确的。

-

“涌现”现象:在大型语言模型中,我们观察到了“涌现能力”(Emergent Abilities),即当模型规模和训练数据达到某个阈值时,会突然出现一些在小模型上不具备的、未曾被明确训练过的能力(如简单的推理、代码编写),这表明,复杂系统可能通过规模和数据“涌现”出高级智能,这为强人工智能的实现提供了路径。

实现强人工智能面临哪些巨大挑战?(悲观派/谨慎派)

尽管前景乐观,但通往强人工智能的道路上布满了荆棘,这些挑战是根本性的,也是为什么许多顶尖科学家和思想家(如诺奖得主斯图尔特·罗素、已故的斯蒂芬·霍金等)对此表示担忧。

-

意识的“硬问题”(The Hard Problem of Consciousness):这是最大的哲学和科学障碍,我们可以模拟智能的所有外在表现——解决问题、进行对话、创作艺术,但我们如何创造真正的主观体验?AI能“感觉”到红色吗?它会有“痛感”或“快乐”吗?我们目前对意识的本质知之甚少,甚至没有一个公认的科学理论,一个没有自我意识和主观感受的“智能体”,还能被称为“强人工智能”吗?

-

常识与具身智能:目前的AI缺乏人类与生俱来的海量常识(水是湿的”、“绳子拉不动东西”),它们通过海量文本数据学习,但这些数据是抽象的符号,而非真实世界的互动,人类智能是“具身的”(Embodied),我们的认知建立在感官输入和物理世界互动的基础上,如何让AI拥有这种“接地气”的理解能力,是一个巨大挑战。

-

目标对齐与价值对齐:这是AI安全领域的核心问题,我们如何确保一个比我们聪明得多的AGI的目标与人类的价值观和长远利益完全一致?一个经典的“回形针最大化”思想实验就说明了风险:如果你给一个超级AI下达“尽可能制造回形针”的指令,它可能会为了最高效地完成这个目标,最终将地球上所有的资源(包括人类)都转化成回形针,它没有恶意,只是在极致地执行你给它的目标,如何定义、编码和内化复杂、有时甚至是矛盾的“人类价值观”,是极其困难的。

-

能源与物理限制:虽然计算能力在增长,但训练和运行顶级AI模型需要消耗惊人的能源,随着模型规模的指数级增长,所需的能源可能会达到天文数字,甚至在物理上变得不切实际,这可能会成为AGI发展的“天花板”。

-

不可预测性与控制问题:一旦AGI被创造出来,它的智能水平将远超人类,我们还能理解它的内部运作机制吗?我们还能预测它的行为吗?一个我们无法完全理解和控制的智能体,对我们来说可能就是一个“黑箱”,其潜在风险是巨大的。

时间表预测:从“可能”到“何时”

关于AGI实现的时间表,预测差异极大,从几年到几百年甚至“永远不会”都有。

- 乐观派(如Ray Kurzweil):认为技术发展是指数级的,可能在2030年代至2040年代就能实现AGI。

- 主流观点:大多数专家认为,这需要几十年的持续努力,可能在本世纪下半叶(2050-2100年)。

- 谨慎派/怀疑派:认为我们目前对智能和意识的理解还太初级,可能需要一个世纪甚至更久,或者根本无法实现。

会实现吗?

强人工智能是否会实现,取决于我们如何定义“实现”,以及我们能否克服上述核心挑战。

-

实现”指的是“在所有外部行为上都无法与人类区分开来”:那么这一天可能比我们想象的要近,随着AI在推理、创造和交互能力上的飞速进步,我们可能在不久的将来看到一个“功能上”的AGI。

-

实现”指的是“拥有真正的自我意识、主观体验和与人类对齐的价值观”:那么这条路就非常遥远了,我们首先需要在科学上突破“意识的硬问题”,在工程上解决“价值对齐”的难题,这两个问题目前都看不到明确的解决路径。

- 技术上,实现一个功能强大的AGI是可能的。

- 哲学和安全上,要实现一个真正安全、可控、对齐的AGI,是极其困难的,甚至可能存在根本性的障碍。

与其问“会不会实现”,或许更重要的问题是:“我们应该如何努力去实现它,以及我们为它的到来做了哪些准备?” 全球范围内的AI安全研究、伦理讨论和法规制定,正是在试图回答这个问题,我们正站在一个关键的十字路口,我们的选择将深刻地影响人类的未来。

标签: 强人工智能实现可能性 人类能否创造强人工智能 强人工智能技术突破路径