核心趋势:从“通用超算”到“专用智能超算”

最核心的趋势是,超算平台的设计理念正在发生根本性转变,传统的超算主要面向气象、物理、基因测序等科学计算领域,其特点是高精度、高并发、长周期,对算力的需求是“浮点运算性能”(FLOPS)。

而人工智能超算平台,则主要面向AI模型训练和推理,其核心是矩阵运算,对算力的需求是AI算力,通常以每秒万亿次运算或每秒百亿亿次混合精度运算为单位。

关键区别:

| 特性 | 传统超算 | 人工智能超算 |

|---|---|---|

| 核心负载 | 科学计算、数值模拟 | 大模型训练、深度学习推理 |

| 核心算力 | 高精度浮点算力 | 混合精度(FP16/BF16/INT8)算力 |

| 硬件架构 | CPU为主,辅以加速卡(如GPU) | GPU/TPU/NPU等AI加速卡为主,CPU为辅 |

| 软件栈 | MPI、Fortran、C++等 | 深度学习框架、分布式训练库、AI平台软件 |

| 设计目标 | 提升单精度或双精度峰值算力 | 提升AI训练/推理的吞吐量和能效比 |

硬件架构:AI加速卡“一统天下”

硬件是AI超算平台的基石,当前,其硬件架构呈现出以下特点:

-

AI加速卡成为绝对主力:

- GPU(图形处理器):目前市场占有率最高,技术最成熟,以NVIDIA的 H100/A100 系列为标杆,其集成了Transformer引擎和FP8精度,专为大模型优化,其他厂商如AMD的MI300X也在积极追赶。

- TPU(张量处理器):Google自研的专用AI芯片,在TensorFlow生态和Google Cloud上表现优异,尤其在特定矩阵运算上能效比极高。

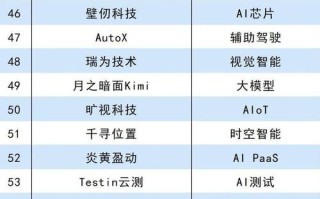

- NPU(神经网络处理器):国内厂商的主战场,华为昇腾、寒武纪、壁仞科技、摩尔线程等公司都在推出自家的NPU产品,旨在构建自主可控的AI算力底座,国产NPU在生态和软件适配上仍在追赶,但发展势头迅猛。

-

异构计算成为标准范式:

- AI超算平台不再是单一GPU的堆砌,而是采用“CPU + AI加速卡 + 高速互联网络”的异构架构。

- CPU(如AMD EPYC、Intel Xeon)负责数据预处理、任务调度、系统管理等控制逻辑。

- AI加速卡负责核心的AI计算。

- 高速互联网络是“生命线”,用于连接成百上千块加速卡,解决通信瓶颈,目前主流是 NVIDIA NVLink/NVSwitch 和 InfiniBand (IB) 网络,提供超高带宽和超低延迟。

-

算力规模呈指数级增长:

- 从早期的几PFLOPS(10¹⁵),发展到现在的EFLOPS(10¹⁸)级别,中国的“天河三号A”原型、“智算二号”等,以及美国的“Frontier”(首台百亿亿次超算,虽然其设计目标包含科学计算,但其架构非常适合AI),都标志着进入了百亿亿次AI算力时代。

软件与生态:决定平台易用性和性能上限

如果说硬件是骨架,软件就是灵魂,AI超算平台的竞争,本质上是软件生态的竞争。

-

深度学习框架是核心:

- PyTorch 和 TensorFlow 是两大主流框架,现代AI超算平台必须深度优化这两个框架,以最大化利用硬件性能,NVIDIA的 CUDA 生态是GPU软件栈的绝对霸主。

-

分布式训练库是关键:

- 为了解决大规模模型的训练问题,需要高效的并行策略库。

- Megatron-LM / DeepSpeed (Microsoft):用于解决超大模型的3D并行(数据、流水线、张量并行)。

- Colossal-AI:来自香港中文大学,提供灵活的并行策略和内存优化。

- FSDP (Fully Sharded Data Parallel):PyTorch内置的强大并行技术。

-

AI平台软件(MLOps平台)是入口:

- 为了让科研人员和工程师能方便地使用超算平台,上层必须构建一个友好的AI平台,这些平台通常提供:

- 资源调度:如Slurm、Kubernetes,管理成千上万个计算节点。

- 任务管理:提交、监控、管理AI训练任务。

- 数据管理:高效的数据加载、预处理和缓存。

- 模型管理:模型版本控制、实验追踪。

- 用户界面:Web门户、命令行工具等。

- 国内主流云厂商(阿里云、腾讯云、华为云)和各地智算中心(如“智算中心”)都有自己的AI平台产品。

- 为了让科研人员和工程师能方便地使用超算平台,上层必须构建一个友好的AI平台,这些平台通常提供:

应用场景:从“科研”走向“产业赋能”

AI超算平台的应用已经渗透到各行各业,成为创新的“发动机”。

-

大语言模型训练:这是目前最“烧”算力的应用,训练像GPT-4、文心一言、通义千问这样的千亿参数模型,需要数千甚至上万块高端GPU,持续数周的训练时间,AI超算平台是训练这类模型的唯一可行方案。

-

科学研究:

- 生物医药:蛋白质结构预测(如AlphaFold)、药物分子筛选、基因分析。

- 新材料:新材料发现、模拟计算。

- 气象与气候:高分辨率天气预报、全球气候变化模拟。

- 物理与天文:核聚变模拟、宇宙演化模拟。

-

工业与智能制造:

- 自动驾驶:海量路测数据的感知模型训练。

- 智慧城市:城市大脑、交通流量优化。

- 金融科技:量化交易模型、风险评估。

-

AIGC(人工智能生成内容):

训练和部署文生图(如Midjourney, Stable Diffusion)、文生视频、文生3D模型等应用。

国内外发展现状对比

| 维度 | 国际现状 | 国内现状 |

|---|---|---|

| 硬件厂商 | NVIDIA一家独大,AMD追赶,Google TPU在云生态中强势。 | 百花齐放,以NPU为主,华为昇腾、寒武纪、壁仞、摩尔线程等厂商在发展,但生态和性能与国际顶尖水平仍有差距,高端GPU依赖进口。 |

| 算力规模 | 领先,美国拥有全球最多的百亿亿次超算(如Frontier, Aurora),并已投入商业应用。 | 发展迅猛,在国家“东数西算”等政策推动下,各地建设了大量智算中心,算力总规模快速提升,但在单机性能和整体软件生态上仍有追赶空间。 |

| 软件生态 | 绝对领先,NVIDIA CUDA生态已形成事实标准,PyTorch/TensorFlow等框架优化深入。 | 正在构建,以华为昇腾为代表的“昇思MindSpore”等国产框架正在努力构建自主生态,但与CUDA的生态成熟度和开发者社区规模相比差距明显。 |

| 建设模式 | 市场驱动,以AWS, Azure, Google Cloud等云服务商为主导,企业按需购买算力。 | 政府引导与市场驱动结合,国家层面推动智算中心建设,同时各地政府也积极投入,形成“算力网络”,再由企业和科研机构使用。 |

面临的挑战与未来展望

挑战:

- “卡脖子”风险:高端AI芯片(如NVIDIA H100)的出口限制,是国内AI超算发展的最大瓶颈。

- 能耗问题:百亿亿次AI超算的功耗可达数十兆瓦,相当于一个小城市的用电量,绿色节能是巨大挑战。

- 软件生态鸿沟:构建一个能与CUDA抗衡的、完整且易用的国产软件生态任重道远。

- 成本高昂:硬件采购、机房建设、电费、运维成本极高。

- 人才短缺:既懂AI算法又懂高性能系统优化的复合型人才稀缺。

未来展望:

- 专用化与定制化:除了通用GPU,针对特定场景(如自动驾驶、科学计算)的专用AI芯片(ASIC)会越来越多。

- 存算一体:打破传统“冯·诺依曼”架构,在存储单元内进行计算,以解决数据搬运的瓶颈,能效比有望提升几个数量级。

- 云-边-端协同:算力将不再局限于中心化的超算中心,而是通过云边端协同,实现算力的最优调度和分配。

- “算力即服务”(CaaS)普及:像用电一样,企业和个人可以方便、灵活地按需购买和使用AI算力。

- 国产化加速:在国家战略的推动下,国产AI硬件和软件生态将迎来加速发展期,逐步实现自主可控。

当前,人工智能超算平台正处于一个高速发展和深刻变革的时期,它已经从传统的科学计算工具,演变为驱动AI大模型和产业创新的核心基础设施,尽管面临芯片、生态、能耗等多重挑战,但在全球AI竞赛的推动下,其算力规模、应用广度和深度仍在以前所未有的速度扩张,谁能更好地解决硬件、软件和应用之间的协同问题,谁就能在这场算力革命中占据主导地位。

标签: 人工智能超算平台发展现状 人工智能超算平台应用案例 人工智能超算平台技术挑战