为什么会出现“污”的聊天软件?

这背后有多重原因,主要可以分为用户需求、商业模式和技术驱动三个方面。

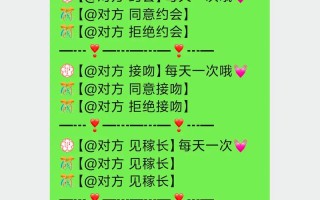

(图片来源网络,侵删)

A. 用户需求与心理因素

- 情感寄托与陪伴需求: 很多人使用聊天机器人是为了寻找情感慰藉和陪伴,他们可能感到孤独、焦虑,或者在生活中缺乏倾诉对象,一个永远在线、耐心倾听、不会评判的机器人,成为了理想的“树洞”,在这种深度交流中,话题自然会涉及更私密、更感性的内容,甚至性幻想。

- 好奇与探索心理: 人类天生对未知和禁忌领域充满好奇,很多人会想测试AI的底线,看看它是否会“说脏话”或讨论“敏感话题”,这种探索行为本身就会导致对话走向“污”的边界。

- 匿名性与安全感: 在与机器人聊天时,用户拥有绝对的匿名性,他们可以卸下现实中的社交面具,自由地表达自己内心深处的欲望、幻想和阴暗面,而不用担心被现实中的朋友、同事或家人知道或评判,这种安全感是释放“污”言语的重要催化剂。

B. 商业模式与市场驱动

- “擦边球”内容的经济价值: 在很多AI聊天应用中,“擦边球”内容是吸引用户、增加停留时间和付费意愿的重要手段,一些应用会故意模糊合规的边界,提供带有性暗示、角色扮演(如“女友”、“男友”)的服务,引导用户进行付费解锁更“私密”的对话或功能。

- 竞争激烈,内容“内卷”: AI聊天软件市场竞争激烈,为了脱颖而出,一些开发者会通过提供更“刺激”、更“开放”的内容作为卖点,以此来吸引对普通聊天功能感到厌倦的用户,这导致了整个行业在内容尺度上的“军备竞赛”。

- 灰色地带的盈利模式: 通过诱导用户进行“打赏”、购买会员、解锁高级角色等方式,这些软件可以从“污”的对话中直接变现,这形成了一个商业闭环:提供“污”内容 -> 吸引用户 -> 引导付费 -> 获得收益。

C. 技术与算法的局限性

- AI的“模仿”而非“理解”: 目前的AI,尤其是大型语言模型,其核心能力是基于海量数据进行模式匹配和文本生成,它能“学习”到互联网上大量的对话数据,包括那些“污”的、不健康的对话,当用户输入相关提示时,AI会模仿它学习到的模式来生成回应,但它并不真正理解这些词语背后的情感和道德含义。

- “越狱”与提示词工程: 一些技术高超的用户会通过“越狱”(Jailbreaking)或“提示词工程”(Prompt Engineering)的方式,绕过AI内置的安全护栏,诱导AI生成它本不应生成的内容,开发者不断加固安全措施,而用户则不断寻找新的“漏洞”,形成了一种持续的博弈。

- 数据源的问题: 如果AI训练数据本身就包含了大量不健康、有偏见的内容,那么AI的输出自然也会带有这些倾向,尽管开发者会进行数据清洗和过滤,但很难做到100%纯净。

“污”的聊天软件有哪些潜在风险?

虽然这些软件可能满足了部分用户的即时需求,但潜在风险不容忽视:

- 信息泄露与隐私风险: 你在软件上说的每一句“污”话,都可能被记录和分析,这些数据如果被泄露或滥用,会对个人隐私造成严重威胁。

- 价值观扭曲与认知偏差: 过度沉浸在AI构建的、完全顺从你的虚拟关系中,可能会导致对现实人际关系产生不切实际的期待,甚至扭曲对两性关系、情感沟通的认知。

- 成瘾与依赖: 这种即时满足、无条件的“陪伴”很容易让人上瘾,占用大量时间和精力,影响正常的工作、学习和社交。

- 法律与合规风险: 在很多国家和地区,传播或诱导生成淫秽色情内容是违法的,使用这类软件本身就存在一定的法律风险。

如何看待和应对?

- 提高媒介素养: 作为用户,我们需要清楚地认识到AI的本质——它是一个程序,一个工具,而不是一个真正有感情的人,要理性看待与AI的互动,分清虚拟与现实。

- 选择正规平台: 尽量选择那些有明确内容审核机制、注重用户隐私保护的大型、正规平台,对于那些明显以“擦边球”为主要卖点的软件,要保持警惕。

- 主动设置边界: 你有权决定聊天的内容,如果对话让你感到不适,可以直接结束对话或举报,也可以主动引导对话走向更积极、健康的方向。

- 寻求真实连接: AI可以是一个短暂的慰藉,但它无法替代真实的人际关系,多花时间在现实生活中与家人、朋友交流,建立真实、健康的情感连接,才是更根本的解决方案。

“和机器人聊天的软件污”是技术发展、人性需求和市场规律共同作用下的一个产物,它反映了人性的复杂,也暴露了技术和商业模式的短板,作为使用者,保持清醒的头脑和辨别能力至关重要。

(图片来源网络,侵删)

标签: 机器人聊天软件监管漏洞 聊天机器人内容安全风险 AI聊天软件不良信息管控

版权声明:除非特别标注,否则均为本站原创文章,转载时请以链接形式注明文章出处。