以下我将从关键突破、代表性论文、会议热点以及领域影响四个方面,为您全面梳理2025年的人工智能论文。

(图片来源网络,侵删)

核心突破:预训练模型范式的确立

2025年最核心、最具影响力的突破,无疑是大规模预训练+下游任务微调范式的全面胜利,这一范式将AI的研发模式从“为每个任务从头训练一个模型”转变为“先在海量无标注数据上训练一个基础模型,然后针对具体任务进行少量微调”。

这主要归功于以下两篇里程碑式的论文:

BERT (Bidirectional Encoder Representations from Transformers)

- : BERT: Pre-training of Deep Bidirectional Transformers for Language Understanding

- 作者: Jacob Devlin, Ming-Wei Chang, Kenton Lee, Kristina Toutanova (Google AI)

- 发表会议: NAACL-HLT 2025

- 核心思想:

- 双向上下文理解: 之前的模型(如ELMo)只能从左到右或从右到左单向理解上下文,BERT通过“掩码语言模型”(Masked Language Model, MLM)任务,在预训练时随机遮盖句子中15%的词,让模型根据整个句子来预测被遮盖的词,从而实现了真正的双向理解。

- 下一句预测: 引入NSP任务,判断两个句子是否是原文中连续的句子,帮助模型学习句子间的关系。

- 预训练-微调框架: 提出了一个清晰且强大的框架,首先在维基百科、图书等海量文本上进行预训练,然后针对特定任务(如情感分析、文本分类)进行微调,就能取得SOTA(State-of-the-Art)效果。

- 影响:

- NLP的“新基准”: BERT在11个主流NLP任务上刷新了纪录,成为新的基准模型。

- “预训练时代”开启: 它确立了“预训练-微调”的行业标准,几乎所有后续的NLP研究都基于这个范式。

- 催生大量变体: RoBERTa, ALBERT, DistilBERT等后续模型都是在BERT基础上的改进。

GPT-2 (Generative Pre-trained Transformer 2)

- : Language Models are Unsupervised Multitask Learners

- 作者: Alec Radford, Jeffrey Wu, Rewon Child, David Luan, Dario Amodei... (OpenAI)

- 发表会议: 无正式会议论文,以技术报告形式发布,但影响力巨大。

- 核心思想:

- 超大规模模型: GPT-2的参数量达到了15亿,是当时最大的语言模型之一,它证明了模型的规模本身就是一种能力。

- 零样本/少样本学习: GPT-2展示了惊人的“零样本”(Zero-shot)学习能力,它不需要针对特定任务进行微调,只需要在输入中用自然语言描述任务,模型就能直接完成,输入 "Translate to French: Hello world.",模型就能输出 "Bonjour le monde."。

- 强大的生成能力: 模型能够生成连贯、流畅且具有创造力的文本,故事、新闻、诗歌样样精通。

- 影响:

- 引发“AI安全”讨论: 由于GPT-2可能被用于生成假新闻、垃圾邮件等,OpenAI最初选择分阶段、小范围发布模型,引发了学界和业界对AI伦理和安全性的广泛讨论。

- 通往通用人工智能的路径: GPT-2展示了单一模型通过大规模学习掌握多种任务的可能性,被视为通往通用人工智能的重要一步。

- 奠定GPT系列的基础: 它是后续更强大的GPT-3、ChatGPT等模型的直接前身。

其他重要领域的代表性论文

除了NLP领域的革命,2025年在计算机视觉、AI伦理、强化学习等领域也涌现了许多重要工作。

计算机视觉

-

Self-Supervised Learning on ImageNet (SimCLR)

(图片来源网络,侵删)

(图片来源网络,侵删)- : A Simple Framework for Contrastive Learning of Visual Representations

- 作者: Ting Chen, Geoffrey Hinton (Google Brain / University of Toronto)

- 发表会议: ICML 2025

- 核心思想: 提出了一种简单而强大的自监督对比学习框架,它通过随机增强同一张图片的两个版本作为“正样本对”,而数据集中其他所有图片的增强版本都作为“负样本对”,让模型学习区分它们。

- 影响: 极大地推动了CV领域自监督学习的发展,其性能在很多任务上超过了有监督预训练,成为后续研究(如MoCo, BYOL)的基础。

-

EfficientNet

- : EfficientNet: Rethinking Model Scaling for Convolutional Neural Networks

- 作者: Mingxing Tan, Quoc V. Le (Google Brain)

- 发表会议: ICML 2025

- 核心思想: 提出了一种“复合缩放法”(Compound Scaling),即均匀地缩放模型的深度、宽度和输入图像分辨率,而不是像以往那样只调整其中一个维度。

- 影响: 在相似的计算量下,EfficientNet系列模型(B0-B7)在准确率和效率上都远超之前的模型,成为计算机视觉中高效模型的典范。

AI伦理与公平性

- Gender Shades: Intersectional Accuracy Disparities in Commercial Gender Classification

- : Gender Shades: Intersectional Accuracy Disparities in Commercial Gender Classification

- 作者: Joy Buolamwini, Timnit Gebru (MIT Media Lab)

- 发表会议: Conference on Fairness, Accountability and Transparency (FAT* 2025)

- 核心思想: 这篇论文是一项开创性的实证研究,作者测试了来自IBM、Microsoft和Amazon等公司的商用人脸识别API,发现它们在识别深肤色女性时的错误率最高(可达34%),而识别浅肤色男性的错误率最低(低于1%)。

- 影响: 这篇论文引爆了对AI系统“算法偏见”(Algorithmic Bias)和“公平性”(Fairness)的全球性讨论,促使科技公司重新审视其数据集和算法,并推动了AI伦理成为AI研究的核心议题之一。

强化学习

- AlphaStar (StarCraft II AI)

- : Grandmaster level in StarCraft II using multi-agent reinforcement learning

- 作者: OpenAI AlphaStar Team

- 发表会议: Nature 2025

- 核心思想: 首次在复杂的即时战略游戏《星际争霸II》中,达到了人类职业选手(Grandmaster)的水平,其关键技术包括多智能体强化学习(让多个AI相互对战)、模仿学习(学习人类专家的开局)和限制观察范围(模拟人类玩家的视野限制)。

- 影响: 证明了AI在具有巨大状态空间和长期规划挑战的复杂游戏中也能取得超人表现,是强化学习领域又一里程碑式的成就。

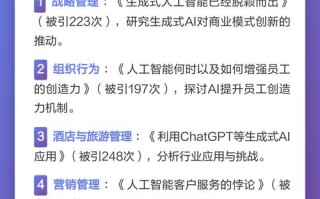

2025年主要AI会议热点

- 预训练模型是绝对主角: NAACL, ACL, EMNLP等NLP顶级会议,几乎所有最佳论文和杰出论文都围绕BERT、GPT-2及其改进展开。

- 自监督学习崛起: ICML, NeurIPS等机器学习顶会,自监督学习(尤其是对比学习)成为CV和NLP领域最热门的研究方向之一。

- AI伦理与公平性成为焦点: FAT*会议持续升温,NeurIPS和ICML等传统机器学习会议也开始设立专门的Workshop和论文 track,讨论AI的公平性、可解释性和社会责任。

- 大规模模型与算力挑战: 随着模型越来越大,训练所需算力呈指数级增长,如何高效训练大模型成为了一个重要的研究课题(如混合精度训练、模型并行等)。

总结与展望

2025年对于人工智能来说是奠基性和范式转变的一年。

- 核心成果: 以BERT和GPT-2为代表的预训练模型,确立了“预训练-微调”的新范式,开启了AI的“大模型时代”。

- 领域拓展: 自监督学习在CV领域取得突破,AI伦理问题从幕后走向台前,强化学习在复杂游戏中继续刷新认知。

- 深远影响: 2025年的工作直接催生了2025年及之后的更多突破,

- GPT-3 (2025): 将规模推向1750亿参数,展现出惊人的少样本学习能力。

- DALL-E / Stable Diffusion (2025-2025): 文本生成图像技术爆发,同样是基于大规模预训练模型。

- ChatGPT (2025): 基于GPT-3.5,将大语言模型的能力推向了大众,引发了生成式AI的浪潮。

可以说,读懂了2025年的这些关键论文,就能理解当今人工智能技术发展的脉络和基石。

标签: 2025人工智能论文突破方向 2025人工智能研究挑战 人工智能2025论文趋势

版权声明:除非特别标注,否则均为本站原创文章,转载时请以链接形式注明文章出处。