这是一个非常好的问题,它触及了人工智能发展的核心。

最完整和准确的答案是:计算能力是人工智能的基石、引擎和催化剂。

我们可以从以下几个层面来理解这句话:

基石:没有计算能力,AI理论就无法落地

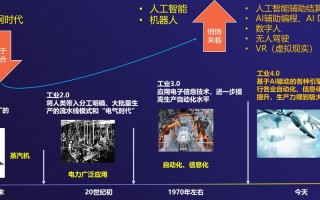

在人工智能的早期(20世纪50-80年代),人们已经提出了许多核心算法和理论,比如神经网络、感知机等,但由于当时计算能力极其有限,这些算法只能处理非常小规模的数据和简单的模型,效果不佳,导致AI经历了多次“寒冬”。

- 比喻:就像拥有了一辆汽车的完美设计图纸,但没有工厂和生产线,这辆车永远无法被制造出来,计算能力就是那个“工厂和生产线”。

核心原因:

- 海量数据处理:现代AI,特别是深度学习,需要从海量的数据中学习规律,没有强大的计算能力,处理TB甚至PB级别的数据是不可能的。

- 复杂模型训练:一个现代的深度学习模型(如GPT-4)可能包含数千亿甚至上万亿个参数,训练这样一个模型需要进行天文数字般的矩阵运算,这只有在强大的计算设备上才能在可接受的时间内完成。

引擎:计算能力驱动了AI的突破和演进

计算能力的每一次飞跃,都直接推动了AI领域的重大突破。

-

关键节点:GPU的普及

- 传统的CPU是为串行任务设计的,而AI的核心是大规模并行计算(同时处理大量数据),GPU(图形处理器)拥有数千个计算核心,天生适合这种并行计算。

- 以Alex Krizhevsky在2012年用GPU训练AlexNet模型并赢得ImageNet竞赛为标志,GPU深度学习时代正式开启,这次成功证明了,强大的计算能力可以训练出远超以往的复杂模型,从而实现质的飞跃。

-

摩尔定律的延续:算力的指数级增长

- 从单个GPU,到多GPU集群,再到TPU(张量处理单元)、NPU(神经网络处理单元)等专用AI芯片,计算能力在过去十年里实现了指数级的增长。

- 这种增长直接催生了:

- 更大的模型:从百万参数到百亿、万亿参数。

- 更强的能力:从图像识别、语音识别,到自然语言处理(如ChatGPT)、AlphaGo战胜世界冠军。

- 更快的训练和推理:模型训练时间从数月缩短到数天甚至数小时,使得AI技术的迭代速度大大加快。

催化剂:计算能力的“范式转移”推动了新算法的诞生

不仅仅是算力的“量”变,其“质”变也会催生新的AI范式。

- 云计算:让中小企业和研究者也能按需租用强大的算力,极大地 democratized(民主化)了AI,催生了无数创新应用。

- 边缘计算:将计算能力从云端推向设备端(如手机、汽车、摄像头),使得低延迟、高隐私的AI应用成为可能(如实时人脸识别、自动驾驶)。

- 量子计算:虽然尚处早期,但其颠覆性的并行计算潜力,有望在未来解决目前经典计算机无法解决的AI难题,如更复杂的优化问题和模拟物理世界。

计算能力与人工智能的关系可以概括为:

算法是灵魂,数据是燃料,而计算能力则是承载这一切、并使其运转起来的强大引擎。

- 过去:计算能力的不足是AI发展的主要瓶颈。

- 现在:计算能力是驱动AI创新和商业化的核心动力。

- 未来:对更强大、更高效、更专用计算能力的追求,将继续定义AI发展的下一个方向。

当人们谈论AI的竞争时,其背后往往是芯片、算力基础设施和计算架构的竞争,可以说,计算能力决定了AI能力的上限。

标签: 人工智能计算能力核心地位 AI计算能力核心要素 计算能力与人工智能核心关系

版权声明:除非特别标注,否则均为本站原创文章,转载时请以链接形式注明文章出处。