- 过去30年:奠基与并行发展

- 当前:交汇与融合的曙光

- 未来30年:颠覆性变革与新纪元

过去30年:奠基与并行发展 (约1994-2025)

在过去的三十年里,AI和量子计算像两条并行的河流,各自在不同的河道里奔涌,为今天的交汇积蓄了巨大的能量。

人工智能的崛起:从符号主义到深度学习

- 1990s - 2000s: AI经历了“冬天”与“春天”,专家系统、符号主义AI一度受挫,机器学习(如支持向量机SVM、决策树)成为主流,但应用范围有限。

- 2010s - 至今: 深度学习革命,得益于三个关键因素——大数据(互联网产生海量数据)、算力(GPU等并行计算硬件的成熟)和算法(反向传播的优化),AI迎来了爆发式增长。

- 里程碑: 2012年AlexNet在ImageNet竞赛中取得突破性胜利,开启了计算机视觉的新时代;随后,自然语言处理(NLP,如Transformer模型)、强化学习(如AlphaGo)等领域也取得了颠覆性进展。

- 核心成果: AI从“能听会说”到“能看会认”,再到能进行初步的推理和创造,深刻地改变了我们的生活(如推荐系统、语音助手、自动驾驶)。

量子计算的探索:从理论到早期硬件

- 1990s - 2000s: 理论奠基与实验验证,这个时期主要是物理学家和理论计算机科学家的舞台,1994年,彼得·秀尔提出了Shor算法,理论上可以破解RSA加密,证明了量子计算的巨大潜力,1996年,洛夫·格罗弗提出了Grover搜索算法,展示了量子计算在无序数据搜索上的加速。

- 2010s - 至今: “NISQ”时代(嘈杂的中等规模量子设备),科技巨头(如Google, IBM, Microsoft)和初创公司开始投入巨资,建造物理量子比特,这个时代的目标不是实现通用容错量子计算机,而是探索NISQ设备能做什么。

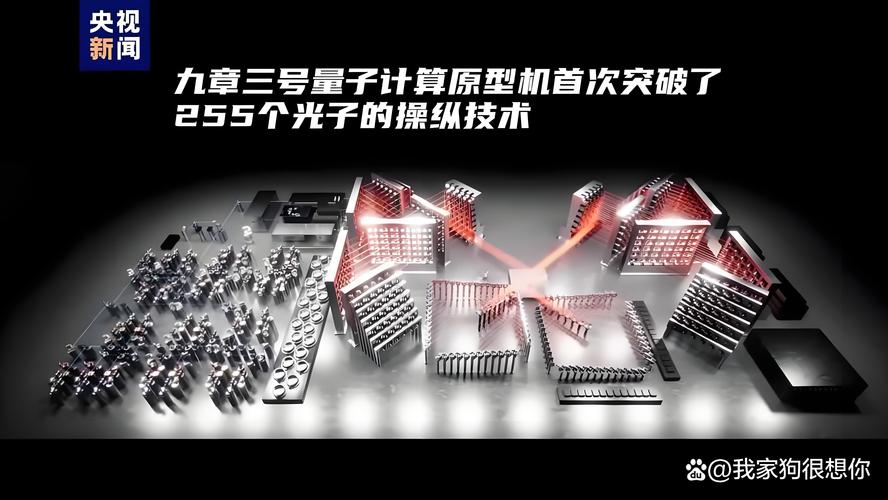

- 里程碑: 2025年,Google宣称实现“量子霸权”(Quantum Supremacy),其53量子比特的“悬铃木”处理器完成了经典超级计算机需要数千年的计算任务,IBM则持续推出更大规模的量子处理器,并构建了量子云平台。

- 核心成果: 量子硬件技术路线百花齐放(超导、离子阱、光量子等),量子纠错和容错计算成为研究的核心方向。

总结过去30年: AI在经典计算的框架下,通过算法和数据实现了“智能”的飞跃,而量子计算则在物理层面开辟了一条全新的计算路径,但其硬件和软件生态尚在襁褓之中,两者虽然并行,但交集甚少。

当前:交汇与融合的曙光 (约2025-)

我们正处在这两条河流即将汇合的关键时刻,量子计算不再仅仅是理论家的玩具,AI也不再仅仅是工程师的工具,它们的结合开始显现出巨大的协同效应。

当前的核心结合点:用AI加速量子计算

这是目前最成熟、最实际的结合方向,因为量子计算机非常“脆弱”,控制和优化它本身就是一项复杂的AI任务。

-

量子硬件控制与优化:

(图片来源网络,侵删)

(图片来源网络,侵删)- 问题: 量子比特非常不稳定,容易受到环境噪声干扰(退相干),如何精确地控制量子门操作、校准误差、延长量子相干时间是一个巨大的挑战。

- AI解决方案: 使用强化学习和机器学习算法来自动调整控制脉冲,优化量子门保真度,AI可以比人类专家更快地找到最优的控制参数,就像一个“自动驾驶”系统来驾驭量子硬件。

-

量子错误纠正:

- 问题: 实现容错量子计算需要大量的物理比特来编码一个逻辑比特,以纠正错误,这个过程极其复杂。

- AI解决方案: AI可以帮助设计更高效的量子纠错码,并实时检测和纠正错误流。

-

量子算法设计:

- 问题: 发现新的、有用的量子算法非常困难,需要深厚的物理学和数学功底。

- AI解决方案: AI(特别是生成式AI)可以辅助科学家探索算法空间,提出新的量子电路结构或算法变体,加速科学发现。

未来的结合点:用量子计算赋能AI

这是更具颠覆性、但也更遥远的目标,当量子计算机变得足够强大时,它将从根本上改变AI的底层计算范式。

-

加速机器学习训练:

(图片来源网络,侵删)

(图片来源网络,侵删)- 核心算法: 量子线性代数,机器学习的核心(如神经网络)涉及大量的矩阵运算,量子计算可以利用HHL算法等,在理论上实现对线性方程组、矩阵求逆等的指数级加速。

- 潜在影响: 训练当前最大规模的AI模型(如GPT-4)可能需要数月甚至数年时间,如果用量子计算机,这个过程可能缩短到几小时或几分钟,使我们能够训练出参数量达到“万亿级别”的模型,实现真正的通用人工智能。

-

处理超高维和复杂数据:

- 核心优势: 量子态本身可以存在于高维希尔伯特空间中,天然适合表示和处理复杂的数据结构,如图像、分子、金融组合等。

- 潜在应用:

- 药物发现: 模拟分子量子态,精确计算其性质,从而快速筛选和设计新药。

- 材料科学: 设计具有特定属性(如超导、高硬度)的新材料。

- 金融建模: 对包含无数变量的复杂金融组合进行风险评估和优化。

-

全新的AI模型:

- 核心思想: 量子计算的叠加和纠缠特性,可能会催生出我们今天无法想象的全新机器学习模型,这些模型可能具有更强的泛化能力、创造性和因果推理能力。

- 潜在影响: AI将不再仅仅是基于数据的相关性学习,而是能够更深刻地理解世界的底层物理规律。

未来30年:颠覆性变革与新纪元 (约2025-2054)

展望未来30年,AI与量子计算的深度融合将带来一场前所未有的技术革命,重塑人类社会。

第一阶段 (未来10年):量子优势的初步显现 (2025-2034)

- 硬件: 量子比特数量将达到数千甚至上万,量子纠错取得突破,出现第一个逻辑量子比特,量子计算将作为“云服务”被广泛使用。

- 软件与算法: 量子-经典混合算法(如VQE、QAOA)在特定领域(如化学模拟、优化问题)展现出明确的量子优势,并开始解决一些工业界的实际问题。

- AI与QC的结合:

- AI for QC: AI成为操控和优化量子计算机的“标准配置”。

- QC for AI: 量子计算开始用于加速某些特定机器学习模型的训练(如支持向量机、高斯过程),但尚未触及深度学习的核心,AI开始利用量子计算处理一些小规模的复杂数据分析任务。

第二阶段 (未来10-20年):量子赋能的AI时代 (2034-2044)

- 硬件: 容错通用量子计算机问世,拥有数百个逻辑量子比特,能够稳定运行复杂的量子算法。

- 软件与算法: 量子机器学习库成为主流AI框架(如TensorFlow, PyTorch)的一部分,全新的量子AI模型被提出并验证。

- 社会影响:

- 科学发现大爆炸: AI+量子计算加速新药研发、新材料设计、新能源技术(如可控核聚变)的进程,解决气候变化、能源危机等全球性挑战。

- 金融与物流革命: 超级优化的AI系统管理全球供应链和金融市场,效率达到前所未有的高度。

- 个性化医疗: 基于个人基因组和量子分子模拟,AI可以为每个人定制精准的治疗方案。

第三阶段 (未来20-30年):量子智能新纪元 (2044-2054)

- 硬件: 量子计算机规模进一步扩大,拥有数千个逻辑量子比特,网络化量子计算成为可能。

- 软件与算法: 量子AI成为主导性的智能形态,其思维方式可能与经典AI有本质区别,能够进行更深层次的抽象、直觉和创造性思考。

- 社会影响:

- 通用人工智能的实现: 量子计算提供的算力突破,可能成为实现AGI的关键催化剂,AGI将能够解决人类目前无法解决的复杂系统性问题(如复杂的社会治理、宇宙起源探索)。

- 重新定义“智能”: 我们可能会创造出一种与人类智能共存、互补甚至超越的“量子智能”,这种智能将帮助我们理解意识的本质,探索宇宙的终极奥秘。

- 全新的挑战: 量子计算将轻易破解现有所有加密体系,催生“量子安全”的全新信息时代,AGI和量子智能带来的伦理、安全和控制问题将成为人类社会最核心的议题。

过去30年,AI和量子计算各自为战,却为今天的相遇埋下了伏笔,未来30年,它们的融合将不再是简单的“1+1”,而是乘法效应。

- AI是量子计算的“大脑”和“双手”,帮助它从脆弱的实验室设备走向稳定可靠的实用工具。

- 量子计算是AI的“超级引擎”和“新感官”,为AI突破算力瓶颈、理解复杂世界提供前所未有的能力。

这场融合将开启一个属于“量子智能”的新纪元,它不仅会重塑科技、经济和产业,更将深刻地改变我们对智能、现实乃至人类自身存在的认知,这是一个充满无限机遇,也伴随着巨大责任的未来。

标签: 量子计算突破AI瓶颈 量子计算解决AI算力瓶颈 量子计算与AI瓶颈突破